Машинное обучение 1/2022 2023 — различия между версиями

Kris ros (обсуждение | вклад) (Новая страница: «тыц») |

F d rose (обсуждение | вклад) |

||

| (не показана одна промежуточная версия ещё одного участника) | |||

| Строка 1: | Строка 1: | ||

| − | + | == О курсе == | |

| + | |||

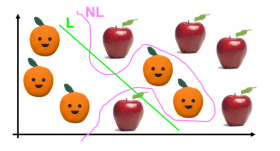

| + | [[Файл:ML_surfaces.png|280px|borderless|left]] | ||

| + | |||

| + | Курс читается для студентов 3-го курса [https://cs.hse.ru/ami ПМИ ФКН ВШЭ] в 1-2 модулях. | ||

| + | |||

| + | Проводится с 2016 года. | ||

| + | |||

| + | '''Лектор:''' [http://www.hse.ru/staff/esokolov Соколов Евгений Андреевич] | ||

| + | |||

| + | Лекции проходят по пятницам, 11:10 - 12:30, в zoom (https://us06web.zoom.us/j/89165579433?pwd=Y1poSzZjZzN0TEFFTjdLQkxqRUxDZz09). | ||

| + | |||

| + | |||

| + | |||

| + | |||

| + | |||

| + | |||

| + | === Полезные ссылки === | ||

| + | |||

| + | [https://www.hse.ru/edu/courses/646510131 Карточка курса и программа] | ||

| + | |||

| + | [https://github.com/esokolov/ml-course-hse Репозиторий с материалами на GitHub] | ||

| + | |||

| + | [https://www.youtube.com/watch?v=OBG6EUSRC9g&list=PLEqoHzpnmTfDwuwrFHWVHdr1-qJsfqCUX Видеозаписи лекций 18/19 года] | ||

| + | |||

| + | Почта для сдачи домашних заданий (на самом деле задания сдаются в AnyTask, но если он не работает, то присылайте на почту): hse.cs.ml+<номер группы>@gmail.com (например, hse.cs.ml+171@gmail.com) | ||

| + | |||

| + | Канал в telegram для объявлений: https://t.me/+oI2qh44oQj82MDEy | ||

| + | |||

| + | Чат в telegram для обсуждений (предназначение чата до конца не ясно, вопросы может быть правильнее задавать в чатах групп): https://t.me/+3BLmxzv63VM0OGMy | ||

| + | |||

| + | Ссылка на курс в Anytask: https://anytask.org/course/970 | ||

| + | |||

| + | [https://docs.google.com/spreadsheets/d/1Z-9POgE6dTwtw5lLWf4PmHLux116zh4LCnpk-o0MKhE/edit?usp=sharing Таблица с оценками] | ||

| + | |||

| + | Оставить отзыв на курс: [https://goo.gl/forms/5CddG0gc75VZvqi52 форма] | ||

| + | |||

| + | '''Вопросы''' по курсу можно задавать в телеграм лектору (esokolov@) или семинаристу. | ||

| + | Вопросы по материалам лекций/семинаров и по заданиям лучше всего задавать на [https://github.com/esokolov/ml-course-hse/discussions форуме]. | ||

| + | |||

| + | === Семинары === | ||

| + | |||

| + | {| class="wikitable" | ||

| + | |- | ||

| + | ! Группа !! Преподаватель | ||

| + | |- | ||

| + | | 201 (МОП) || [https://t.me/amshabalin Шабалин Александр Михайлович] | ||

| + | |- | ||

| + | | 202 (МОП) || [https://www.hse.ru/staff/esokolov Соколов Евгений Андреевич] | ||

| + | |- | ||

| + | | 203 (МОП) || [https://t.me/Birshert Биршерт Алексей Дмитриевич] | ||

| + | |- | ||

| + | | 204 (ТИ) || [https://t.me/madn_boi Морозов Никита Витальевич] | ||

| + | |- | ||

| + | | 205 (РС) || [https://www.hse.ru/org/persons/218009880 Ульянкин Филипп Валерьевич] | ||

| + | |- | ||

| + | | 206 (РС) || [https://t.me/kostyayatsok Еленик Константин Ильич] | ||

| + | |- | ||

| + | | 207 (АПР) || [https://t.me/cherepasska Миша Баранов] | ||

| + | |- | ||

| + | | 208 (АДИС) || [https://www.hse.ru/staff/atsvigun Аким Цвигун] | ||

| + | |- | ||

| + | | 209 (МИ) || [https://t.me/call_me_Dory Сусла Диана Михайловна] | ||

| + | |- | ||

| + | | 2010 (ПР) || [https://t.me/artidoz Щербинин Артем Андреевич] | ||

| + | |- | ||

| + | | ФЭН || [https://www.hse.ru/org/persons/190889495 Зехов Матвей Сергеевич] | ||

| + | |} | ||

| + | |||

| + | === Ассистенты === | ||

| + | |||

| + | {| class="wikitable" | ||

| + | |- | ||

| + | ! Группа !! Ассистент | ||

| + | |- | ||

| + | | 201 (МОП) || [https://t.me/artempris Артем Присяжнюк], [https://t.me/ipomeya31 Александр Плахин] | ||

| + | |- | ||

| + | | 202 (МОП) || [https://t.me/pauchara0 Олег Петров], [https://t.me/fdrose Максим Абрахам] | ||

| + | |- | ||

| + | | 203 (МОП) || [https://t.me/Nikita_Ki33elev Никита Киселев], [https://t.me/sagerasimov_1 Сергей Герасимов] | ||

| + | |- | ||

| + | | 204 (ТИ) || [https://t.me/vslvskyy Юлия Василевская] | ||

| + | |- | ||

| + | | 205 (РС) || [https://t.me/defunator Семен Иванов], [https://t.me/territhing Сергей Пилипенко] | ||

| + | |- | ||

| + | | 206 (РС) || [https://t.me/sol_arch Никита Андреев], [https://t.me/abezrukovaa Анастасия Безрукова] | ||

| + | |- | ||

| + | | 207 (АПР) || [https://t.me/leksious Алексей Панков] | ||

| + | |- | ||

| + | | 208 (АДИС) || [https://t.me/annastep2001 Анна Степочкина], [https://t.me/aleph0naught Александр Орлов] | ||

| + | |- | ||

| + | | 209 (МИ) || [https://t.me/arinakosovskaia Арина Косовская] | ||

| + | |- | ||

| + | | 2010 (ПР) || [https://t.me/territhing Сергей Пилипенко] | ||

| + | |- | ||

| + | | ФЭН || [https://t.me/zhan2pac Жанту Жуматаев], [https://t.me/grandananas Антон Макаров] | ||

| + | |} | ||

| + | |||

| + | === Правила выставления оценок === | ||

| + | |||

| + | В курсе предусмотрено несколько форм контроля знания: | ||

| + | * Самостоятельные работы на семинарах, проверяющие знание основных фактов с лекций и семинаров | ||

| + | * Практические домашние работы на Python | ||

| + | * Письменная контрольная работа | ||

| + | * Письменный экзамен | ||

| + | |||

| + | Итоговая оценка вычисляется на основе оценки за работу в семестре и оценки за экзамен: | ||

| + | |||

| + | Итог = Округление(0.15 * ПР + 0.4 * ДЗ + 0.15 * КР + 0.3 * Э) | ||

| + | |||

| + | ПР — средняя оценка за самостоятельные работы на семинарах | ||

| + | |||

| + | ДЗ — средняя оценка за практические домашние работы на Python | ||

| + | |||

| + | КР — оценка за контрольную работу | ||

| + | |||

| + | Э — оценка за экзамен | ||

| + | |||

| + | Округление арифметическое. | ||

| + | |||

| + | === Правила сдачи заданий === | ||

| + | |||

| + | За каждый день просрочки после мягкого дедлайна снимается 1 балл. После жёсткого дедлайна работы не принимаются. Даже при опоздании на одну секунду. Сдавайте заранее. | ||

| + | |||

| + | Два раза студент может сдать домашнее задание после мягкого дедлайна (но до жёсткого) без штрафов. | ||

| + | |||

| + | При обнаружении плагиата оценки за домашнее задание обнуляются всем задействованным в списывании студентам, а также подаётся докладная записка в деканат. Следует помнить, что при повторном списывании деканат имеет право отчислить студента. | ||

| + | |||

| + | При наличии уважительной причины пропущенную проверочную можно написать позднее, а дедлайн по домашнему заданию может быть перенесён. Дедлайн по домашнему заданию переносится на количество дней, равное продолжительности уважительной причины. Решение о том, является ли причина уважительной, принимает исключительно учебный офис. | ||

| + | |||

| + | == Лекции == | ||

| + | |||

| + | Ко всем конспектам на GitHub есть исходники. Исправления и дополнения всячески приветствуются! | ||

| + | |||

| + | Записи с доски можно найти [[https://www.dropbox.com/sh/f6k08r3rf0mgzcg/AACImtlxI1my8xes7MBHQaEEa?dl=0 здесь]] | ||

| + | |||

| + | |||

| + | '''Лекция 1''' (2 сентября). Введение в машинное обучение. Основные термины, постановки задач и примеры применения. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture01-intro.pdf Конспект]] [[https://youtu.be/-tz5KDMKd4E Запись лекции]] | ||

| + | |||

| + | '''Лекция 2''' (9 сентября). Линейная регрессия, функции потерь в регрессии. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture02-linregr.pdf Конспект]] [[https://www.youtube.com/watch?v=iNYUmd0-_UU&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=3 Запись лекции]] | ||

| + | |||

| + | '''Лекция 3''' (16 сентября). Обобщающая способность, градиентные методы обучения. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture03-linregr.pdf Конспект]] [[https://www.youtube.com/watch?v=Ydcv-fCV9EY&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=5 Запись лекции]] | ||

| + | |||

| + | '''Лекция 4''' (23 сентября). Градиентные методы, регуляризация. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture04-linregr.pdf Конспект]] [[https://www.youtube.com/watch?v=poz4wf5lALE&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=7 Запись лекции]] | ||

| + | |||

| + | '''Лекция 5''' (1 октября). Регуляризация, линейная классификация. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture05-linclass.pdf Конспект]] [[https://www.youtube.com/watch?v=2AqpyBr2Ji0&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=8 Запись лекции]] | ||

| + | |||

| + | '''Лекция 6''' (7 октября). Метрики качества классификации, логистическая регрессия. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture06-linclass.pdf Конспект]] [[https://www.youtube.com/watch?v=d0KfYeF-A9A&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=11 Запись лекции]] | ||

| + | |||

| + | '''Лекция 7''' (14 октября). Логистическая регрессия, метод опорных векторов. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture07-linclass.pdf Конспект]] [[https://www.youtube.com/watch?v=m-MUD9901J0&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=13 Запись лекции]] | ||

| + | |||

| + | '''Лекция 8''' (22 октября). Многоклассовая классификация, решающие деревья. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture08-trees.pdf Конспект]] [[https://www.youtube.com/watch?v=cB2sQeoZ2lY&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=15 Запись лекции]] | ||

| + | |||

| + | '''Лекция 9''' (6 ноября). Решающие деревья, разложение ошибки на смещение и разброс. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture09-ensembles.pdf Конспект]] [[https://www.youtube.com/watch?v=hzLT7Qn1jKw&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=16 Запись лекции]] | ||

| + | |||

| + | '''Лекция 10''' (14 ноября). Бэггинг, случайные леса. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture10-ensembles.pdf Конспект]] [[https://www.youtube.com/watch?v=HEVS8MTuIdQ&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=17 Запись лекции]] | ||

| + | |||

| + | '''Лекция 11''' (22 ноября). Градиентный бустинг. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture11-ensembles.pdf Конспект]] [[https://www.youtube.com/watch?v=u-SEdfsxOm8&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=19 Запись лекции]] | ||

| + | |||

| + | '''Лекция 12''' (24 ноября). Градиентный бустинг. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture11-ensembles.pdf Конспект]] [[https://www.youtube.com/watch?v=ya2sOjVSNRk&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=20 Запись лекции]] | ||

| + | |||

| + | '''Лекция 13''' (13 декабря). Кластеризация. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture12-unsupervised.pdf Конспект]] [[https://www.youtube.com/watch?v=a6kOoIC7KRM&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=21 Запись лекции]] | ||

| + | |||

| + | '''Лекция 14''' (16 декабря). Кластеризация и визуализация. [[https://github.com/esokolov/ml-course-hse/blob/master/2021-fall/lecture-notes/lecture12-unsupervised.pdf Конспект]] [[https://www.youtube.com/watch?v=SiJWwYXtudw&list=PLEwK9wdS5g0ohn4v-t8yaCOEAC0KT3EPf&index=22 Запись лекции]] | ||

| + | |||

| + | == Семинары == | ||

| + | |||

| + | '''Семинар 1'''. pandas. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem01-pandas.ipynb Ноутбук]] | ||

| + | |||

| + | '''Семинар 2'''. sklearn и линейная регрессия. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem02-sklearn-linregr.ipynb Ноутбук]] | ||

| + | |||

| + | '''Семинар 3'''. Матрично-векторное диффернцирование. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem03-vector-diff.pdf Конспект]] | ||

| + | |||

| + | '''Семинар 4'''. Работа с данными и признаками. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem04-features.ipynb Ноутбук]] | ||

| + | |||

| + | '''Семинар 5'''. Метрики классификации. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem05-linclass-metrics.pdf Конспект]] | ||

| + | |||

| + | '''Семинар 6'''. Калибровка вероятностей. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem06-calibration.ipynb Ноутбук]][[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem06-probs-quantile.pdf Конспект]] | ||

| + | |||

| + | '''Семинар 7'''. Решающие деревья. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem07-trees.ipynb Ноутбук]][[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem07-trees.pdf Конспект]] | ||

| + | |||

| + | '''Семинар 8'''. Разложение ошибки на смещение и разброс. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem08-bvd.pdf Конспект]] | ||

| + | |||

| + | '''Семинар 9'''. Градиентный бустинг. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem09-gbm-part1.pdf Конспект]] | ||

| + | |||

| + | '''Семинар 10'''. Виды градиентного бустинга: XGB, LightGBM, CatBoost. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem10-gbm.pdf Конспект]] | ||

| + | |||

| + | '''Семинар 11'''. Кластеризация. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem11_clustering.ipynb Ноутбук]] | ||

| + | |||

| + | '''Семинар 12'''. Методы понижения размерности: PCE, tSNE. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem12-pca.pdf Конспект]][[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/seminars/sem12_pca_tsne.ipynb Ноутбук]] | ||

| + | |||

| + | == Практические задания == | ||

| + | |||

| + | '''Задание 1.''' Pandas и распределение студентов ПМИ по элективам. | ||

| + | |||

| + | Мягкий дедлайн: 22.09.2022 23:59 MSK. | ||

| + | |||

| + | Жесткий дедлайн: 29.09.2022 23:59 MSK. | ||

| + | |||

| + | [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-01-pandas.ipynb Ноутбук с заданием]] | ||

| + | |||

| + | Также вы можете скачать ноутбук с заданием (если у вас установлен Wget) командой wget <ссылка на ноутбук> (скопируйте [https://raw.githubusercontent.com/esokolov/ml-course-hse/master/2022-fall/homeworks-practice/homework-practice-01-pandas.ipynb ссылку]) или из Google Colab: | ||

| + | |||

| + | [[https://colab.research.google.com/github/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-01-pandas.ipynb Open In Colab]] | ||

| + | |||

| + | '''Задание 2.''' Exploratory Data Analysis и линейная регрессия (садитесь заранее плиз). | ||

| + | |||

| + | Дата выдачи: 25.09.2022 | ||

| + | |||

| + | Мягкий дедлайн: 23:59MSK 10.10.2022 | ||

| + | |||

| + | Жесткий дедлайн: 23:59MSK 18.10.2022 | ||

| + | |||

| + | [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-02-linregr.ipynb Ноутбук с заданием]] | ||

| + | |||

| + | [[https://colab.research.google.com/github/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-02-linregr.ipynb Open In Colab]] | ||

| + | |||

| + | '''Задание 3.''' Градиентный спуск своими руками. | ||

| + | |||

| + | Дата выдачи: 12.10.2022 | ||

| + | |||

| + | Мягкий дедлайн: 23:59MSK 01.11.2022 | ||

| + | |||

| + | Жесткий дедлайн: 23:59MSK 08.11.2022 | ||

| + | |||

| + | [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-03-gd/homework-practice-03-gd.ipynb Ноутбук с заданием]] | ||

| + | |||

| + | '''Задание 4.''' Линейная классификация, калибровка, категориальные признаки и отбор признаков. | ||

| + | |||

| + | Дата выдачи: 04.11.2022 | ||

| + | |||

| + | Мягкий дедлайн: 23:59MSK 16.11.2022 | ||

| + | |||

| + | Жесткий дедлайн: 23:59MSK 23.11.2022 | ||

| + | |||

| + | [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-04-linclass.ipynb Ноутбук с заданием]] | ||

| + | |||

| + | '''Задание 5.''' Решающие деревья. | ||

| + | |||

| + | Дата выдачи: 18.11.2022 | ||

| + | |||

| + | Мягкий дедлайн: 23:59MSK 30.11.2022 | ||

| + | |||

| + | Жесткий дедлайн: 23:59MSK 06.12.2022 | ||

| + | |||

| + | [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-05-trees/homework-practice-05-trees.ipynb Ноутбук с заданием]] | ||

| + | |||

| + | '''Задание 6.''' Разложение ошибки на смещение и разброс. | ||

| + | |||

| + | Дата выдачи: 01.12.2022 | ||

| + | |||

| + | Мягкий дедлайн: 23:59MSK 11.12.2022 | ||

| + | |||

| + | Жесткий дедлайн: 23:59MSK 15.12.2022 | ||

| + | |||

| + | [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-06-bvd.ipynb Ноутбук с заданием]] | ||

| + | |||

| + | '''Задание 7.''' Бустинговое. | ||

| + | |||

| + | Дата выдачи: 13.12.2022 | ||

| + | |||

| + | Жесткий дедлайн: 23:59MSK 20.12.2022 | ||

| + | |||

| + | [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-practice/homework-practice-07-boosting/homework-practice-07-boosting.ipynb Ноутбук с заданием]] | ||

| + | |||

| + | ==Теоретические домашние задания== | ||

| + | |||

| + | '''Теоретическое ДЗ 1.''' Линейные модели. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-theory/homework-theory-01-linear-models.pdf Задания]] | ||

| + | |||

| + | '''Теоретическое ДЗ 2.''' Матрично-векторное дифференцирование и градиентный спуск. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-theory/homework-theory-02-derivatives.pdf Задания]] | ||

| + | |||

| + | '''Теоретическое ДЗ 3.''' Логистическая регрессия и метрики классификации. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-theory/homework-theory-03_part1-logreg-svm.pdf Часть 1]][[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-theory/homework-theory-03_part2-clf-metrics.pdf Часть 2]] | ||

| + | |||

| + | '''Теоретическое ДЗ 4.''' Разложение ошибки на смещение и разброс. [[https://github.com/esokolov/ml-course-hse/blob/master/2022-fall/homeworks-theory/homework-theory-04-bvd.pdf Задания]] | ||

| + | |||

| + | == Соревнования == | ||

| + | |||

| + | ===Правила участия и оценивания=== | ||

| + | В соревновании по анализу данных вам предлагается по имеющимся данным решить некоторую задачу, оптимизируя указанную метрику, и отправить ответы для заданного тестового множества. Максимальное количество посылок в сутки ограничено (как правило, разрешается сделать 2 посылки), ближе к концу соревнования вам будем необходимо выбрать 2 посылки, которые вы считаете лучшими. Тестовые данные делятся на публичные и приватные в некотором соотношении, на основе которых строятся публичный и приватный лидерборды соответственно, при этом публичный лидерборд доступен в течение всего соревнования, а приватный строится после его окончания для выбранных вами посылок. | ||

| + | |||

| + | В лидербордах каждого из соревнований присутствуют несколько базовых решений (бейзлайнов), каждое из которых соответствует определённой оценке. Например, для получения оценки не ниже 8 баллов необходимо, чтобы ваше решение на '''приватном''' лидерборде оказалось лучше соответствующего бейзлайна. Далее для студента, преодолевшего бейзлайн на N_1 баллов, но не преодолевшего бейзлайн на N_2 балла, итоговая оценка за соревнование рассчитывается по равномерной сетке среди всех таких студентов в зависимости от места в приватном лидерборде среди них; если быть точными, то по следующей формуле: | ||

| + | |||

| + | N_2 - (N_2 - N_1) * i / M, | ||

| + | |||

| + | где M — количество студентов (из всех студентов, изучающих курс), преодолевших бейзлайн на N_1 баллов, но не преодолевших бейзлайн на N_2 балла; | ||

| + | |||

| + | i — место (начиная с 1) студента в приватном лидерборде среди всех таких студентов. | ||

| + | |||

| + | Единственное исключение из формулы — студенты, преодолевшие самый сильный бейзлайн, получают прибавку 1/M к своей оценке. | ||

| + | |||

| + | Чтобы вас не пропустили при проверке решений соревнования, '''необходимо''' использовать следующий формат для имени команды (вкладка Team): | ||

| + | |||

| + | «[ПМИ] Имя Фамилия номер_группы» | ||

| + | |||

| + | В течение 3 суток после окончания соревнования в соответствующее задание на anytask необходимо прислать код, воспроизводящий ответы для посылки, фигурирующей в приватном лидерборде. При оформлении кода предполагайте, что данные лежат рядом с ним в папке data, а в результате выполнения кода ответы должны быть записаны в файл solution-N-Username.csv, где N — номер соревнования, Username — ваша фамилия. У нас должна быть возможность запустить код и получить те же ответы, что и в вашей посылке, — в частности, это означает, что: | ||

| + | |||

| + | 1. Если вы отправляете файл *.py, мы будем запускать его при помощи команды python *.py в вышеуказанном предположении о местонахождении данных. | ||

| + | |||

| + | 2. Если вы отправляете ноутбук *.ipynb, мы последовательно запустим все ячейки ноутбука и будем ожидать в результате его работы формирование файла с ответами. | ||

| + | |||

| + | 3. Если вы отправляете код с использованием другого языка программирования, в том же письме направьте нам инструкцию по его запуску с тем, чтобы получить тот же файл с ответами. | ||

| + | |||

| + | В случае отсутствия кода, воспроизводящего результат, в установленный срок студенту выставляется 0 в качестве оценки за соревнование. Студенты, попавшие в топ-3 согласно приватному лидерборду, смогут получить бонусные баллы, если в течение недели после окончания соревнования сдадут в anytask отчет о получении решения, фигурирующего в приватном лидерборде. Если не оговорено иное, использовать любые внешние данные в соревнованиях '''запрещено'''. Под внешними данными понимаются размеченные данные, где разметка имеет прямое отношение к решаемой задаче. Грубо говоря, сборник текстов с википедии не считается внешними данными. | ||

| + | |||

| + | В некоторых соревнованиях данные взяты из завершившегося соревнования на Kaggle. | ||

| + | Категорически запрещено использовать данные из оригинального соревнования для восстановления целевой переменной на тестовой выборке. | ||

| + | |||

| + | === Соревнование 1 === | ||

| + | |||

| + | Задача: классификация отзывов | ||

| + | |||

| + | Это соревнование на бонусные баллы, оно не является обязательным. | ||

| + | |||

| + | Ссылка для участия: https://www.kaggle.com/t/eb20383504ce4d85ba27c5b12e7767ec | ||

| + | |||

| + | Дедлайн: 10.12.2022 17:00MSK | ||

| + | |||

| + | В задании всего один бейзлайн, ненулевые баллы получают решения, преодолевшие его на приватном лидерборде. | ||

| + | Все решения выше этого бейзлайна оцениваются по равномерной шкале от 0 до 5. | ||

| + | |||

| + | '''Важно''': в соревновании запрещено использовать глубинное обучение (как свои архитектуры, так и результаты предобученных моделей вроде w2v, fasttext, bert ит.д.). | ||

| + | |||

| + | == Бонусы за соревнования == | ||

| + | |||

| + | За успешное участие в соревнованиях по анализу данных могут быть выставлены бонусные баллы, которые можно прибавить к оценке за любое практическое или теоретическое домашнее задание, а также за самостоятельную работу. Под успешным участием понимается попадание в топ-10% мест; если соревнование особо сложное и крупное, может рассматриваться и попадание в топ-20% мест. Конкретное число баллов определяется преподавателями и зависит от сложности соревнования и занятого места. За одно соревнование можно получить не более 5 баллов. Для получения оценки необходимо предоставить краткий отчёт о решении задачи. | ||

| + | |||

| + | == Контрольная работа == | ||

| + | |||

| + | Контрольная работа состоится 2 декабря на лекции. Продолжительность — 80 минут. | ||

| + | |||

| + | [https://docs.google.com/document/d/1ZWBWIcctdA4T30Ml4MCQp3xrTn5GUU_yrQtTYc9QgJ8/edit?usp=sharing Вопросы для подготовки] | ||

| + | |||

| + | [https://github.com/esokolov/ml-course-hse/blob/master/2020-fall/midterm-fall-2020-example.pdf Нулевой вариант] | ||

| + | |||

| + | [https://github.com/hse-ds/iad-intro-ds/blob/master/2021/kr/kr2021-var0.pdf Нулевой вариант с майнора ИАД (попроще, но всё равно полезно прорешать)] | ||

| + | |||

| + | == Экзамен == | ||

| + | |||

| + | [https://docs.google.com/document/d/1azsoR_l2itVB_fFDveMN5zJcXq5cj0OranAM-4esV-k/edit?usp=sharing Вопросы для подготовки] | ||

| + | |||

| + | == Полезные материалы == | ||

| + | ===Книги=== | ||

| + | * [https://academy.yandex.ru/handbook/ml Учебник по машинному обучению от ШАД] | ||

| + | * Hastie T., Tibshirani R, Friedman J. The Elements of Statistical Learning (2nd edition). Springer, 2009. | ||

| + | * Bishop C. M. Pattern Recognition and Machine Learning. Springer, 2006. | ||

| + | * Mohri M., Rostamizadeh A., Talwalkar A. Foundations of Machine Learning. MIT Press, 2012. | ||

| + | * Murphy K. Machine Learning: A Probabilistic Perspective. MIT Press, 2012. | ||

| + | * Mohammed J. Zaki, Wagner Meira Jr. Data Mining and Analysis. Fundamental Concepts and Algorithms. Cambridge University Press, 2014. | ||

| + | * Willi Richert, Luis Pedro Coelho. Building Machine Learning Systems with Python. Packt Publishing, 2013. | ||

| + | |||

| + | ===Курсы по машинному обучению и анализу данных=== | ||

| + | * [http://www.machinelearning.ru/wiki/index.php?title=Машинное_обучение_%28курс_лекций%2C_К.В.Воронцов%29 Курс по машинному обучению К.В. Воронцова] | ||

| + | * [https://yandexdataschool.ru/edu-process/courses/machine-learning Видеозаписи лекций курса Школы Анализа Данных, К.В. Воронцов] | ||

| + | * [https://www.coursera.org/specializations/machine-learning-from-statistics-to-neural-networks Coursera: Машинное обучение от статистики до нейросетей (специализация)] | ||

| + | * [https://www.coursera.org/specializations/machine-learning-data-analysis Coursera: Машинное обучение и анализ данных (специализация)] | ||

| + | * [https://www.coursera.org/learn/introduction-machine-learning Coursera: Введение в машинное обучение, К.В. Воронцов] | ||

| + | * [https://openedu.ru/course/hse/INTRML/ Введение в машинное обучение (онлайн-курс НИУ ВШЭ)] | ||

| + | |||

| + | == Страницы предыдущих лет == | ||

| + | |||

| + | [[Машинное_обучение_1/2021_2022 | 2021/2022 учебный год]] | ||

| + | |||

| + | [[Машинное_обучение_1/2020_2021 | 2020/2021 учебный год]] | ||

| + | |||

| + | [[Машинное_обучение_1/2019_2020 | 2019/2020 учебный год]] | ||

| + | |||

| + | [[Машинное_обучение_1/2018_2019 | 2018/2019 учебный год]] | ||

| + | |||

| + | [[Машинное_обучение_1/2017_2018 | 2017/2018 учебный год]] | ||

| + | |||

| + | [[Машинное_обучение_1/2016_2017 | 2016/2017 учебный год]] | ||

Текущая версия на 18:45, 7 сентября 2023

Содержание

О курсе

Курс читается для студентов 3-го курса ПМИ ФКН ВШЭ в 1-2 модулях.

Проводится с 2016 года.

Лектор: Соколов Евгений Андреевич

Лекции проходят по пятницам, 11:10 - 12:30, в zoom (https://us06web.zoom.us/j/89165579433?pwd=Y1poSzZjZzN0TEFFTjdLQkxqRUxDZz09).

Полезные ссылки

Репозиторий с материалами на GitHub

Почта для сдачи домашних заданий (на самом деле задания сдаются в AnyTask, но если он не работает, то присылайте на почту): hse.cs.ml+<номер группы>@gmail.com (например, hse.cs.ml+171@gmail.com)

Канал в telegram для объявлений: https://t.me/+oI2qh44oQj82MDEy

Чат в telegram для обсуждений (предназначение чата до конца не ясно, вопросы может быть правильнее задавать в чатах групп): https://t.me/+3BLmxzv63VM0OGMy

Ссылка на курс в Anytask: https://anytask.org/course/970

Оставить отзыв на курс: форма

Вопросы по курсу можно задавать в телеграм лектору (esokolov@) или семинаристу. Вопросы по материалам лекций/семинаров и по заданиям лучше всего задавать на форуме.

Семинары

| Группа | Преподаватель |

|---|---|

| 201 (МОП) | Шабалин Александр Михайлович |

| 202 (МОП) | Соколов Евгений Андреевич |

| 203 (МОП) | Биршерт Алексей Дмитриевич |

| 204 (ТИ) | Морозов Никита Витальевич |

| 205 (РС) | Ульянкин Филипп Валерьевич |

| 206 (РС) | Еленик Константин Ильич |

| 207 (АПР) | Миша Баранов |

| 208 (АДИС) | Аким Цвигун |

| 209 (МИ) | Сусла Диана Михайловна |

| 2010 (ПР) | Щербинин Артем Андреевич |

| ФЭН | Зехов Матвей Сергеевич |

Ассистенты

| Группа | Ассистент |

|---|---|

| 201 (МОП) | Артем Присяжнюк, Александр Плахин |

| 202 (МОП) | Олег Петров, Максим Абрахам |

| 203 (МОП) | Никита Киселев, Сергей Герасимов |

| 204 (ТИ) | Юлия Василевская |

| 205 (РС) | Семен Иванов, Сергей Пилипенко |

| 206 (РС) | Никита Андреев, Анастасия Безрукова |

| 207 (АПР) | Алексей Панков |

| 208 (АДИС) | Анна Степочкина, Александр Орлов |

| 209 (МИ) | Арина Косовская |

| 2010 (ПР) | Сергей Пилипенко |

| ФЭН | Жанту Жуматаев, Антон Макаров |

Правила выставления оценок

В курсе предусмотрено несколько форм контроля знания:

- Самостоятельные работы на семинарах, проверяющие знание основных фактов с лекций и семинаров

- Практические домашние работы на Python

- Письменная контрольная работа

- Письменный экзамен

Итоговая оценка вычисляется на основе оценки за работу в семестре и оценки за экзамен:

Итог = Округление(0.15 * ПР + 0.4 * ДЗ + 0.15 * КР + 0.3 * Э)

ПР — средняя оценка за самостоятельные работы на семинарах

ДЗ — средняя оценка за практические домашние работы на Python

КР — оценка за контрольную работу

Э — оценка за экзамен

Округление арифметическое.

Правила сдачи заданий

За каждый день просрочки после мягкого дедлайна снимается 1 балл. После жёсткого дедлайна работы не принимаются. Даже при опоздании на одну секунду. Сдавайте заранее.

Два раза студент может сдать домашнее задание после мягкого дедлайна (но до жёсткого) без штрафов.

При обнаружении плагиата оценки за домашнее задание обнуляются всем задействованным в списывании студентам, а также подаётся докладная записка в деканат. Следует помнить, что при повторном списывании деканат имеет право отчислить студента.

При наличии уважительной причины пропущенную проверочную можно написать позднее, а дедлайн по домашнему заданию может быть перенесён. Дедлайн по домашнему заданию переносится на количество дней, равное продолжительности уважительной причины. Решение о том, является ли причина уважительной, принимает исключительно учебный офис.

Лекции

Ко всем конспектам на GitHub есть исходники. Исправления и дополнения всячески приветствуются!

Записи с доски можно найти [здесь]

Лекция 1 (2 сентября). Введение в машинное обучение. Основные термины, постановки задач и примеры применения. [Конспект] [Запись лекции]

Лекция 2 (9 сентября). Линейная регрессия, функции потерь в регрессии. [Конспект] [Запись лекции]

Лекция 3 (16 сентября). Обобщающая способность, градиентные методы обучения. [Конспект] [Запись лекции]

Лекция 4 (23 сентября). Градиентные методы, регуляризация. [Конспект] [Запись лекции]

Лекция 5 (1 октября). Регуляризация, линейная классификация. [Конспект] [Запись лекции]

Лекция 6 (7 октября). Метрики качества классификации, логистическая регрессия. [Конспект] [Запись лекции]

Лекция 7 (14 октября). Логистическая регрессия, метод опорных векторов. [Конспект] [Запись лекции]

Лекция 8 (22 октября). Многоклассовая классификация, решающие деревья. [Конспект] [Запись лекции]

Лекция 9 (6 ноября). Решающие деревья, разложение ошибки на смещение и разброс. [Конспект] [Запись лекции]

Лекция 10 (14 ноября). Бэггинг, случайные леса. [Конспект] [Запись лекции]

Лекция 11 (22 ноября). Градиентный бустинг. [Конспект] [Запись лекции]

Лекция 12 (24 ноября). Градиентный бустинг. [Конспект] [Запись лекции]

Лекция 13 (13 декабря). Кластеризация. [Конспект] [Запись лекции]

Лекция 14 (16 декабря). Кластеризация и визуализация. [Конспект] [Запись лекции]

Семинары

Семинар 1. pandas. [Ноутбук]

Семинар 2. sklearn и линейная регрессия. [Ноутбук]

Семинар 3. Матрично-векторное диффернцирование. [Конспект]

Семинар 4. Работа с данными и признаками. [Ноутбук]

Семинар 5. Метрики классификации. [Конспект]

Семинар 6. Калибровка вероятностей. [Ноутбук][Конспект]

Семинар 7. Решающие деревья. [Ноутбук][Конспект]

Семинар 8. Разложение ошибки на смещение и разброс. [Конспект]

Семинар 9. Градиентный бустинг. [Конспект]

Семинар 10. Виды градиентного бустинга: XGB, LightGBM, CatBoost. [Конспект]

Семинар 11. Кластеризация. [Ноутбук]

Семинар 12. Методы понижения размерности: PCE, tSNE. [Конспект][Ноутбук]

Практические задания

Задание 1. Pandas и распределение студентов ПМИ по элективам.

Мягкий дедлайн: 22.09.2022 23:59 MSK.

Жесткий дедлайн: 29.09.2022 23:59 MSK.

Также вы можете скачать ноутбук с заданием (если у вас установлен Wget) командой wget <ссылка на ноутбук> (скопируйте ссылку) или из Google Colab:

Задание 2. Exploratory Data Analysis и линейная регрессия (садитесь заранее плиз).

Дата выдачи: 25.09.2022

Мягкий дедлайн: 23:59MSK 10.10.2022

Жесткий дедлайн: 23:59MSK 18.10.2022

Задание 3. Градиентный спуск своими руками.

Дата выдачи: 12.10.2022

Мягкий дедлайн: 23:59MSK 01.11.2022

Жесткий дедлайн: 23:59MSK 08.11.2022

Задание 4. Линейная классификация, калибровка, категориальные признаки и отбор признаков.

Дата выдачи: 04.11.2022

Мягкий дедлайн: 23:59MSK 16.11.2022

Жесткий дедлайн: 23:59MSK 23.11.2022

Задание 5. Решающие деревья.

Дата выдачи: 18.11.2022

Мягкий дедлайн: 23:59MSK 30.11.2022

Жесткий дедлайн: 23:59MSK 06.12.2022

Задание 6. Разложение ошибки на смещение и разброс.

Дата выдачи: 01.12.2022

Мягкий дедлайн: 23:59MSK 11.12.2022

Жесткий дедлайн: 23:59MSK 15.12.2022

Задание 7. Бустинговое.

Дата выдачи: 13.12.2022

Жесткий дедлайн: 23:59MSK 20.12.2022

Теоретические домашние задания

Теоретическое ДЗ 1. Линейные модели. [Задания]

Теоретическое ДЗ 2. Матрично-векторное дифференцирование и градиентный спуск. [Задания]

Теоретическое ДЗ 3. Логистическая регрессия и метрики классификации. [Часть 1][Часть 2]

Теоретическое ДЗ 4. Разложение ошибки на смещение и разброс. [Задания]

Соревнования

Правила участия и оценивания

В соревновании по анализу данных вам предлагается по имеющимся данным решить некоторую задачу, оптимизируя указанную метрику, и отправить ответы для заданного тестового множества. Максимальное количество посылок в сутки ограничено (как правило, разрешается сделать 2 посылки), ближе к концу соревнования вам будем необходимо выбрать 2 посылки, которые вы считаете лучшими. Тестовые данные делятся на публичные и приватные в некотором соотношении, на основе которых строятся публичный и приватный лидерборды соответственно, при этом публичный лидерборд доступен в течение всего соревнования, а приватный строится после его окончания для выбранных вами посылок.

В лидербордах каждого из соревнований присутствуют несколько базовых решений (бейзлайнов), каждое из которых соответствует определённой оценке. Например, для получения оценки не ниже 8 баллов необходимо, чтобы ваше решение на приватном лидерборде оказалось лучше соответствующего бейзлайна. Далее для студента, преодолевшего бейзлайн на N_1 баллов, но не преодолевшего бейзлайн на N_2 балла, итоговая оценка за соревнование рассчитывается по равномерной сетке среди всех таких студентов в зависимости от места в приватном лидерборде среди них; если быть точными, то по следующей формуле:

N_2 - (N_2 - N_1) * i / M,

где M — количество студентов (из всех студентов, изучающих курс), преодолевших бейзлайн на N_1 баллов, но не преодолевших бейзлайн на N_2 балла;

i — место (начиная с 1) студента в приватном лидерборде среди всех таких студентов.

Единственное исключение из формулы — студенты, преодолевшие самый сильный бейзлайн, получают прибавку 1/M к своей оценке.

Чтобы вас не пропустили при проверке решений соревнования, необходимо использовать следующий формат для имени команды (вкладка Team):

«[ПМИ] Имя Фамилия номер_группы»

В течение 3 суток после окончания соревнования в соответствующее задание на anytask необходимо прислать код, воспроизводящий ответы для посылки, фигурирующей в приватном лидерборде. При оформлении кода предполагайте, что данные лежат рядом с ним в папке data, а в результате выполнения кода ответы должны быть записаны в файл solution-N-Username.csv, где N — номер соревнования, Username — ваша фамилия. У нас должна быть возможность запустить код и получить те же ответы, что и в вашей посылке, — в частности, это означает, что:

1. Если вы отправляете файл *.py, мы будем запускать его при помощи команды python *.py в вышеуказанном предположении о местонахождении данных.

2. Если вы отправляете ноутбук *.ipynb, мы последовательно запустим все ячейки ноутбука и будем ожидать в результате его работы формирование файла с ответами.

3. Если вы отправляете код с использованием другого языка программирования, в том же письме направьте нам инструкцию по его запуску с тем, чтобы получить тот же файл с ответами.

В случае отсутствия кода, воспроизводящего результат, в установленный срок студенту выставляется 0 в качестве оценки за соревнование. Студенты, попавшие в топ-3 согласно приватному лидерборду, смогут получить бонусные баллы, если в течение недели после окончания соревнования сдадут в anytask отчет о получении решения, фигурирующего в приватном лидерборде. Если не оговорено иное, использовать любые внешние данные в соревнованиях запрещено. Под внешними данными понимаются размеченные данные, где разметка имеет прямое отношение к решаемой задаче. Грубо говоря, сборник текстов с википедии не считается внешними данными.

В некоторых соревнованиях данные взяты из завершившегося соревнования на Kaggle. Категорически запрещено использовать данные из оригинального соревнования для восстановления целевой переменной на тестовой выборке.

Соревнование 1

Задача: классификация отзывов

Это соревнование на бонусные баллы, оно не является обязательным.

Ссылка для участия: https://www.kaggle.com/t/eb20383504ce4d85ba27c5b12e7767ec

Дедлайн: 10.12.2022 17:00MSK

В задании всего один бейзлайн, ненулевые баллы получают решения, преодолевшие его на приватном лидерборде. Все решения выше этого бейзлайна оцениваются по равномерной шкале от 0 до 5.

Важно: в соревновании запрещено использовать глубинное обучение (как свои архитектуры, так и результаты предобученных моделей вроде w2v, fasttext, bert ит.д.).

Бонусы за соревнования

За успешное участие в соревнованиях по анализу данных могут быть выставлены бонусные баллы, которые можно прибавить к оценке за любое практическое или теоретическое домашнее задание, а также за самостоятельную работу. Под успешным участием понимается попадание в топ-10% мест; если соревнование особо сложное и крупное, может рассматриваться и попадание в топ-20% мест. Конкретное число баллов определяется преподавателями и зависит от сложности соревнования и занятого места. За одно соревнование можно получить не более 5 баллов. Для получения оценки необходимо предоставить краткий отчёт о решении задачи.

Контрольная работа

Контрольная работа состоится 2 декабря на лекции. Продолжительность — 80 минут.

Нулевой вариант с майнора ИАД (попроще, но всё равно полезно прорешать)

Экзамен

Полезные материалы

Книги

- Учебник по машинному обучению от ШАД

- Hastie T., Tibshirani R, Friedman J. The Elements of Statistical Learning (2nd edition). Springer, 2009.

- Bishop C. M. Pattern Recognition and Machine Learning. Springer, 2006.

- Mohri M., Rostamizadeh A., Talwalkar A. Foundations of Machine Learning. MIT Press, 2012.

- Murphy K. Machine Learning: A Probabilistic Perspective. MIT Press, 2012.

- Mohammed J. Zaki, Wagner Meira Jr. Data Mining and Analysis. Fundamental Concepts and Algorithms. Cambridge University Press, 2014.

- Willi Richert, Luis Pedro Coelho. Building Machine Learning Systems with Python. Packt Publishing, 2013.

Курсы по машинному обучению и анализу данных

- Курс по машинному обучению К.В. Воронцова

- Видеозаписи лекций курса Школы Анализа Данных, К.В. Воронцов

- Coursera: Машинное обучение от статистики до нейросетей (специализация)

- Coursera: Машинное обучение и анализ данных (специализация)

- Coursera: Введение в машинное обучение, К.В. Воронцов

- Введение в машинное обучение (онлайн-курс НИУ ВШЭ)